Illustration: Felix Kumpfe/Studio Hurra

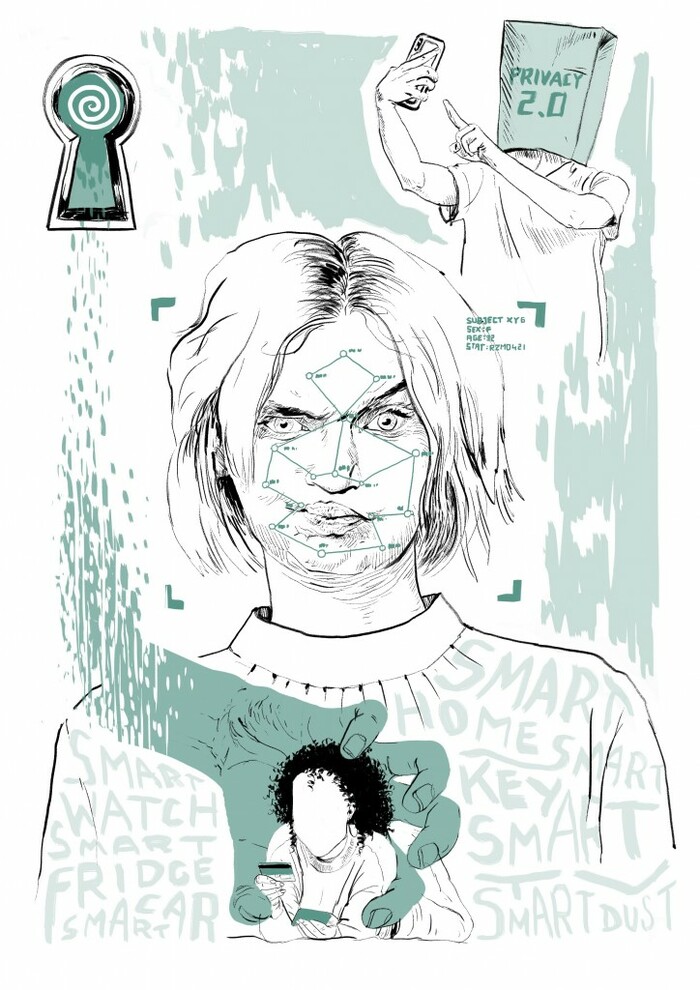

Die Debatte, wie unsere digitale Umgebung unsere Identität beeinflusst und wie sich die in unser Leben eingebettete Computerisierung auf unsere individuellen Fähigkeiten auswirkt, wird an verschiedenen Stellen geführt. Weil Diskussionen über Körper und das Ich aber unsere innersten Gefühle berühren, berühren sie sehr oft auch unsere Emotionen. Was die einen Menschen als Kurzstrecke in die Dystopie empfinden, ist für andere eine technologiegestützte Hoffnung. Niemanden lassen Implantate, Datenschatten, Roboter oder die Verbesserung menschlicher Fähigkeiten durch technische Hilfsmittel kalt. Politische Bildung kann einen Beitrag leisten, die Debatten und Phänomene sensibel einzuordnen, und mit den realen Entwicklungen der digitalen Transformation zu kontrastieren. Sie kann Reflexion über die Grenzlinien, ab denen die Angelegenheit unbehaglich wird, und Debatten über die gewünschte Richtung der Digitalisierung nahe des menschlichen Körpers und Geistes ermöglichen.

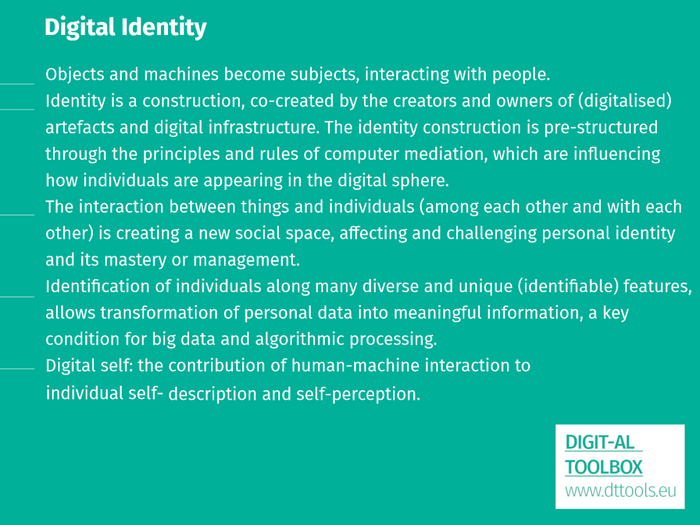

Wenn Identität eine Konstruktion ist, die von den Schöpfer*innen und Besitzer*innen (digitalisierter) Artefakte und der digitalen Infrastruktur mitgestaltet wird, dann wird auch das digitale Ich durch die Prinzipien und Regeln der Computervermittlung vorstrukturiert sein. Die Interaktion zwischen Dingen und Individuen (untereinander z. B. über Plattformen und im Miteinander zwischen Menschen und Technik) schafft einen neuen sozialen Raum, der die persönliche Identität beeinflusst, und die „Verwaltung“ unserer digitalen Präsenzen wird zunehmend herausfordernd. Konkret erzeugen Nutzer*innen und Plattformen nicht nur persönliche Datenspuren oder Datenschatten, sondern auch in der Summe Abbilder von Individuen, die über eine bloße Verlängerung ihres analogen Erscheinungsbildes hinausgehen.

Technisierte Umgebung

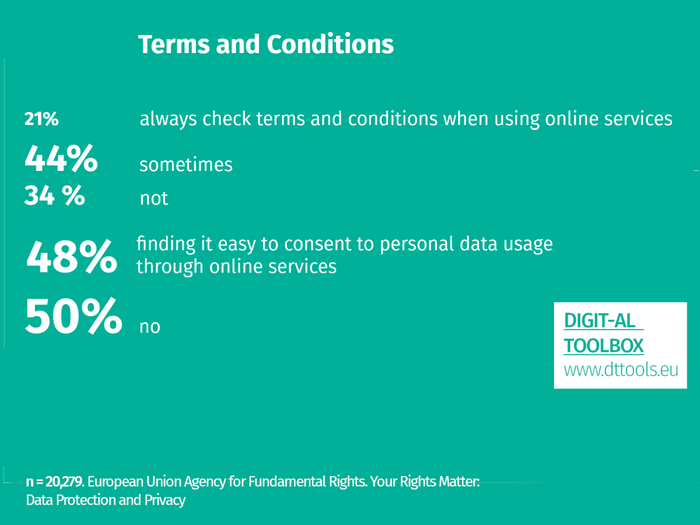

Die Art der technischen Umsetzung trägt zur Verwirrung bei. Menschen installieren in der Regel zahlreiche Apps, nutzen im Durchschnitt zehn täglich und mehr als dreißig im Monat (vgl. AppAnnie,2017). Laut CISCO wird die Anzahl der Geräte pro Kopf bis 2023 auf 9,4 in Westeuropa und 4 in Osteuropa ansteigen (vgl. CISCO 2020). Es ist einfach, in einen Wald hineinzugehen, aber schwierig, den Weg hinaus zu finden. Ähnlich verhält es sich mit dem App- und Daten-Ökosystem. Viele Bemühungen zielen darauf ab, die neuen Informationstechnik (IT)-Produkte von Anfang an benutzungsfreundlich zu gestalten. Doch mit jeder neuen App, jedem Update, jedem neuen Gerät, jeder neuen Funktion, jeder neuen App-Berechtigung oder jeder neuen Art der Verarbeitung schwindet der Überblick der Einzelnen über ihre vernetzte IT oder ihre vielen Installationen. So wird Kontrolle schwieriger und unübersichtlicher.

Außerdem steht die Frage im Raum, welche Daten die Apps erheben,wie sicher sie und ob ihre Analysemodelle zuverlässig sind. Moll et. al zeigten große Lücken in Sachen Sensibilität und Datenschutz von beispielsweise Fitness-Apps auf (vgl. Moll et al. 2017). Der Markt ist insbesondere bei Gesundheits-Apps intransparent, ihre Entwicklung orientiert sich nicht an Nutzer*innen-Bedürfnissen und aus gesellschaftlicher Perspektive scheint die Reflexion ihrer Potenziale nicht ausreichend in die Produktentwicklung einzufließen (vgl. Bertelsmann Stiftung, 2016).

Mehrwert und Verwertung

Zuboff (2015) weist darauf hin, dass die wirtschaftliche Grundlage vieler Dienste und Plattformen eine Technisierung des digitalen Ichs ist. Der Körper wird technisch „extrahiert“, dass heißt in Daten zerlegt und in Modellen der Verhaltensanalyse zusammengesetzt. Das Versprechen von personalisierten Angeboten kann die Entpersonalisierung der digitalen Menschen zur Folge haben. Persönlichen Daten werden nach der aktuell dominanten Logik der großen Plattformen, die sie „Überwachungskapitalismus“ nennt, mit den Mitteln und den Modellen von Verhaltenspsychologie und Big Data in Verhaltensvorhersagemodelle umgeformt und ökonomisch verwertet. Dies geschieht weitgehend unter Ausschluss der Nutzer*innen und diesen die Rolle als zuverlässig Datenmaterial Produzierende zuweisend (vgl. Zuboff, 2015). In diesem Sinne steht die Frage im Raum, wie Nutzer*innen die Geschäftsmodelle der Dienste und der mit ihnen verbundenen Geräte besser verstehen können.

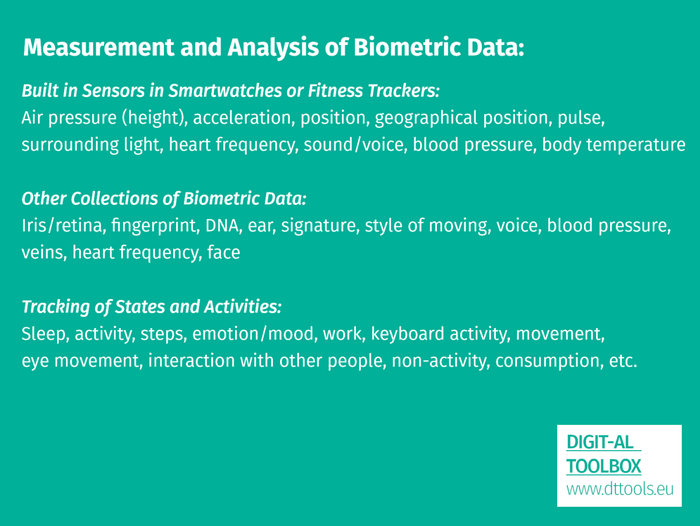

Identifikation und Biometrie

Theoretisch könnte regelmäßige Pflege und Wartung der Herausforderung mangelnder Übersicht abhelfen. Allerdings besteht ein weiteres Problem darin, dass die spezifische Mischung von Apps und Geräten Einzelpersonen identifizierbar macht, denn die Informationen über installierte Apps und verwendete Geräte werden häufig an Dritte weitergegeben. Vielen Menschen ist dabei nicht klar, dass die Identifikation von Personen entlang vieler verschiedener und einzigartiger Merkmale ein entscheidender Aspekt der digitalen Identität ist, quasi die Grundlage für moderne Datenanalyse. De-Anonymisierung und personenbezogenes Tracking können nicht als Ausnahmen behandelt werden. Es braucht Anerkennung, dass sie Bedingungen von Ubiquitous Computing (die Allgegenwärtigkeit der rechnergestützten Informationsverarbeitung) und Big Data sind. Auch die als gesellschaftlich wünschenswert betrachteten Varianten können nicht 100 Prozent Anonymität gewährleisten.

Biometrische Technologie identifiziert Menschen anhand persönlicher Eigenschaften. Sie vergleicht dabei reale Körpermerkmale mit abgespeicherten Daten. Die europäische Datenschutzgrundverordnung beschreibt, um welche Art von Daten es sich dabei handelt: „Personendaten aus einem speziellen technischen Prozess, die sich auf die physischen, physiologischen oder Verhaltenseigenschaften einer natürlichen Person beziehen, die die einzigartige Identifizierung dieser natürlichen Person ermöglichen oder bestätigen, wie Gesichtsbilder oder daktyloskopische Daten“ (Artikel 4 der EU-Datenschutzgrundverordnung). Auf Personalausweisen sind biometrische Daten gespeichert, Irisscans, Fingerabdrücke, Gesichtsprofile werden nicht mehr nur in spezieller Überwachungs- und Zugangstechnik eingesetzt, sondern werden auch in Smartphones und anderen Geräten für Verbraucher*innen genutzt. DNA-Profile werden gesammelt,Körperdaten erfasst. Vieles davon wird geteilt.So ermöglicht oder verwehrt Biometrie Menschen oder einzelnen sozialen Gruppen Zugang. Sie kann zur Überwachung von Orten und Einzelnen genutzt werden: „Die Befürchtung ist, dass Gesichtserkennung letztendlich zu einer Situation führen kann, in der es nicht mehr länger möglich ist, eine Straße anonym hinunterzulaufen oder einkaufen zu gehen“ (EWSA, 2019). Auch eröffnen sich neue Möglichkeiten für Diebstahl und Diskriminierung durch den Besitz biometrischer Daten. Dies erfordert eine kritische Auseinandersetzung über biometrische Technologie und mögliche strenge Regulierungen. So auch durch die EU-Kommission, die sie in ihrem Weißbuch zur Künstlichen Intelligenz als kritische Technologie erwähnt (vgl. EU COM 2020/65 final).

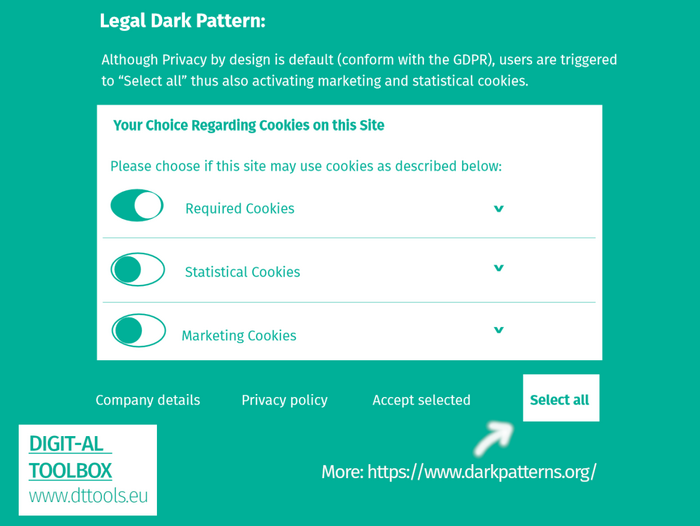

Angewendete Verhaltenspsychologie

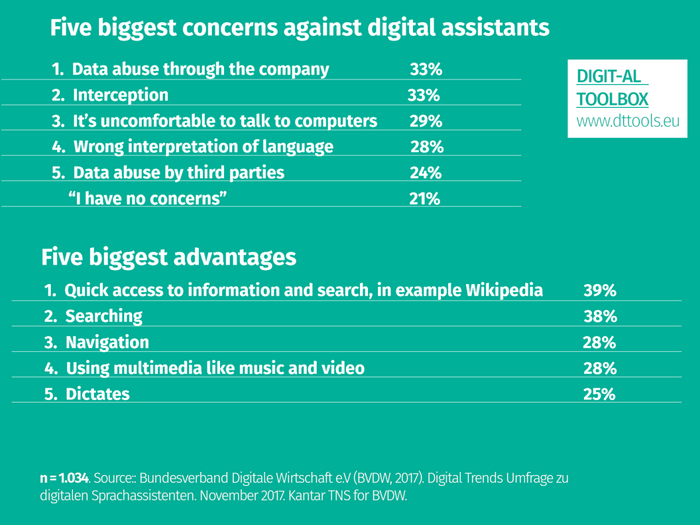

Unser Verhalten wird im Digitalen durch Anwendung von Techniken der Verhaltenspsychologie (wie Gamification-Elemente, soziale Experimente der Plattformen mit ihren Nutzer*innen oder Nudging) auch beeinflusst. Bekannt sind manipulative Gestaltungen wie Popups, die den Menschen nahelegen, in Tracking einzuwilligen, oder Elemente, die uns zum impulsiven Onlinekauf verleiten sollen. Diese nennt man dark patterns. Oft ist der Button, mit dem man in Dritt-Parteien-Tracking einwilligt bunter als der Button für die Einstellung für minimales Tracking. Andere Beispiele wollen Nutzer*innen dazu verleiten, auf etwas zu klicken, ein Abo oder Schadsoftware. Bekannt sind auch Nachrichten im Stil von ‘nur noch wenige Exemplare zu diesem Preis verfügbar’.

Überwachungskapitalismus bringt eine neue Form der Macht hervor: instrumentelle Macht. Dies ist die Macht, menschliches Verhalten zu kennen und und in Richtung der Zwecke Anderer zu formen. Das ist eine unerreichte Qualität von Macht, komplett anders als der Totalitarismus. Statt durch Waffen und Armeen, Terror und Mord, setzt die instrumentelle Macht ihren Willen durch das automatisierte Medium einer zunehmend ubiquitären, durch das Internet ermöglichten computerisierten Architektur der “smart” vernetzten Geräte, Dinge und Orte durch.“

Shoshana Zuboff

Der Körper

Nicht zuletzt hat die Digitalisierung eine psycho-physische Dimension. Je mehr Mensch-Maschine-Interaktion üblich wird, desto mehr verändert dies auch unsere individuelle Selbstbeschreibung und Selbstwahrnehmung. Wir müssen dabei gar nicht die plakativen Bilder von Cyborgs und Robotern abrufen, denn technisch gesehen, gehen einige Geräte schon lange starke und manchmal sogar dauerhafte Verbindungen mit unserem physischen Körper ein. Am offensichtlichsten sehen ist das in der medizinischen Therapie. Einige sind invasiv, z. B. durch das Implantieren eines Sensors in den Körper, andere nicht-invasiv. Am bekanntesten sind wohl die Herzschrittmacher.

Im Zusammenhang mit Datafizierung und Vernetzung dieser Geräte entstehen neue Fragen im Zusammenhang mit Kontrolle und Sicherheit. Ebenfalls dem Trend zur Automatisierung folgend, entwickeln Industrieroboter neue Funktionen zur besseren Interaktion. Der technologische Trend deutet in Richtung einer in den (Arbeits-)Alltag eingebetteten Robotik. Die International Federation of Robotics denkt, dass Roboter durch Sensoren und intelligentere Steuerung vorsichtiger oder zusammenarbeitsfähiger werden und nicht mehr aus Sicherheitsgründen in Käfigen eingesperrt sein müssen (vgl. IFR, 2020).

Smartphones, Smart Watches oder Fitnesstracker illustrieren, dass interaktive körpernahe Maschinen die therapeutischen (oder militärischen) Zwecke, für die sie oft erfunden wurden, verlassen und in die Alltagskultur eindringen. Dadurch ändern sich auch die Vorstellungen von menschlichen Fähigkeiten. Spätestens seit der ersten Sesamstraßenfolge im bundesdeutschen Fernsehen wird über die Auswirkung von Bildschirmen auf die Gesundheit und die Entwicklung geistiger Fähigkeiten debattiert. Nachfolgedebatten drehten sich um Computerspiele, Onlinespiele oder Smartphones.

Fest steht, dass Medien und Technologie eine Auswirkung auf unser Denkvermögen und körperlichen Fähigkeiten haben: „Doch das gilt auch für Bücher und jede andere Form des Lernens und Erlebens“ (Reinberger, 2017, S. 3).

Meyer und Asrock weisen uns auf die Verschiebung der Wahrnehmung von Menschen mit Behinderungen hin, eingeleitet durch moderne Prothesen. Werden sie bislang als ‚warme‘ und inkompetente Mitmenschen betrachtet und sehr oft bemitleidet, verschieben moderne Prothesen unter Umständen ihr Image hin zu kompetenteren aber weniger ‚warmen‘ Mitmenschen. Ein neues Stereotyp tritt ggf. an die Stelle eines alten (vgl. Meyer & Asrock, 2018). Nimmt eine technische Perspektive auf Behinderung und Körper überhand und verdrängt die Diskussion über die Inklusion, kann dies bei Beseitigung eines Teilproblems von Behinderung zu neuen Stigmatisierungen führen oder alte Ausgrenzungsmuster erneuern.

Quantified Self

Kritiker*innen argumentieren, die ständige Präsenz von Optimierung und Bewertung, die Verfügbarkeit von Leistungsdaten und die Konfrontation mit (Mainstream-)Bildern von Körpern im Internet könnten zu einer stillen Dashboardisierung‚ des Selbst führen. Es wird befürchtet, dass die Gesellschaft als Ganzes diese Normen nun zu sehr verinnerlichen könnte.

Verfechter*innen der Idee des „Quantified Self“ akzeptieren die erwähnten Quantifizierungswerkzeuge. Der Begriff beschreibt laut Meidert und Scheermesser, dass „eine Person sich aktiv mit Geräten und Applikationen misst, um aufgrund derAnalyseresultate Wissen zu generieren, das dazu beiträgt, ihren Lebensstil und ihr Verhalten in den Bereichen Fitness, Wellness oder Gesundheit zu optimieren“ (Meidert et al., 2018, S. 44).

Diese Personen haben sehr unterschiedliche Interessen. Die einen sind aus medizinischen Gründen dazu gezwungen, andere sehen sie als nützliche Hilfe an, um ihre Gesundheit nicht zu vernachlässigen, eher wenige versuchen aus den Mitteln, im Sinne ihrer Performance-Optimierung, alles rauszuholen.

Die meisten Menschen scheinen zumindest laut der Studie von Meidert et al. eine balancierte Einstellung zu den neuen digitalen Werkzeugen zu haben, durchaus gemischt mit Pragmatismus, Kritik,Angst vor Abhängigkeit oder dem Drang nach Autonomie. Die große Mehrheit scheint sich des Risikos bewusst zu sein, angesichts einer exzessiven Quantified Self-Praxis sich zu sehr von Normen abhängig zu machen, die andere setzen. Diejenigen, die auf soziale Solidaritätangewiesen sind (wie Menschen mit gesundheitlichen Problemen)haben aber mehr Bedenken gegenüber dem Quantified Self als diejenigen, die sich ohne Probleme in den Normen bewegen.

Körperbilder

Als Verstärker von emotionalen und berührenden Inhalten haben insbesondere Social-Media-Plattformen einen starken Einfluss auf das psychische Wohlbefinden von Individuen und auf deren körperliche Selbstwahrnehmung. Eine Studie über das Körpergewicht italienischer Frauen weist darauf hin, dass ‘Normalität‘ als statistisches Schreckgespenst nicht mit einer ethischen ‘Norm‘ gleichzusetzen ist. Die Auswertung der Interviews verdeutlicht, „dass Mädchen und junge Frauen sich wünschen, dünner zu sein, was sie dazu bringt, dann gesunde Verhaltensweisen zu vernachlässigen. Sie priorisieren die soziale Akzeptanz eher als ihr eigenes Wohlbefinden und ihre Lebensqualität“ (Di Giacomo et al., 2018, S. 6). Soziale Medien verstärken solche Ergebnisse. Gleichzeitig ermöglichen digitale Medien auch das Aufkommen von Gegentrends wie #BodyPositivity (ein Hashtag, der von Menschen verwendet wird, die sich dem dominanten Schönheitstrend nicht unterordnen wollen) unterstützt haben. Jede Social-Media-Plattform scheint einen anderen Einfluss zu haben. Die Royal Society for Public Health stellte beispielsweise fest, dass YouTube weniger normativ in der Förderung von Körperbildern zu sein scheint als beispielsweise Instagram (vgl. Royal Society for Public Health, 2017).

Anknüpfungspunkte für die politische Bildung

In einer breiteren Perspektive schärft die politische Bildung das Bewusstsein dafür, dass digitale Transformation Treiber für soziale Inklusion und Teilhabe sein, aber auch zu neuen Barrieren und Ausschlüssen führen kann.

Körper-Maschine-Interaktion nimmt zu, und auch die Herausforderungen in Bezug auf demokratische Einstellungen, Werte und Rechte müssen angesprochen werden. Die öffentlichen Diskussionen begannen für Prothetik und Robotik (z. B. Diskriminierung, Verletzlichkeit, fairer Zugang) oder für die Biometrie als Risikotechnologie (Potenzial für Ausgrenzung, Überwachung) und politische Bildung kann hier direkt anknüpfen.

Politische Bildung trägt außerdem zum Verständnis datenökonomischer Modelle bei: Sie thematisiert, wie diese Modelle durch Sammlung und Verknüpfung digitaler Daten mit dem „digitalen Ich“ umgehen und auf diese Weise Gewinne erwirtschaften. Dazu sind folgende Fragen Bestandteil politischer Bildung: Wie sehen Alternativen aus? Gibt es Möglichkeiten der Gewinnbeteiligung für Nutzer*innen? Wie können Nutzer*innen Algorithmen mitgestalten oder diese gar ohne lukrative Zeitverwertung der sensiblen persönlichen Daten auskommen?

Die Technologie bietet auch Zugang zu Werkzeugen für die Selbstoptimierung und das quantifizierte Selbst. Politische Bildung regt die Lernenden hier zu einem bewussten und reflektierten Umgang an.

Politische Bildung kontrastiert auch die Vorstellungen und Erscheinungen von Körpern und Fähigkeiten, wie sie für Nutzer*innen in der digitalen Sphäre erscheinen, mit dem Pluralismus und der Vielfalt von Erscheinungen und (Schönheits-)Idealen kontrastieren. Hashtags wie #BodyPositivity stehen dabei ebenso wie maximal inszenierte Instagram-Posts für die digitalen Körperbilder im Fokus.

Veröffentlicht im Rahmen des Projekts: DIGIT-AL – Digital Transformation Adult Learning for Active Citizenship. DARE Blue Lines, Democracy and Human Rights Education in Europe, Brussels 2020. Auf deutsch vom Autor veröffentlicht unter einer CC-BY-SA 4.0 Lizenz auf politischbilden.de

Gamification, Dark Patterns oder die Verstärkung von Emotionen durch Plattform-Mechanismen begünstigen das Suchtverhalten von Menschen mit Suchtveranlagung oder von vulnerablen Gruppen (insbesondere von Jugendlichen). Politische Bildung hilft den Lernenden, diese Mechanismen zu reflektieren und Fähigkeiten zu stärken, mit digitaler Omnipräsenz umzugehen.

Ein beachtlicher Teil des heutigen Internets besteht aus sozialen Beziehungen, und auch analoge und digital ermöglichte Beziehungsgestaltung überschneiden sich zunehmend. Damit gewinnen soziale Beziehungskompetenzen an Bedeutung, verstanden als reflektierte Einschätzung der eigenen Position im Netz sozialer Beziehungen und auch der individuellen Fähigkeit, Beziehungen in der online- und analogen Welt herzustellen und zu pflegen. Damit wird dies zu einem expliziten Thema der politischen Bildung, während es früher eher implizit angestrebt wurde.

Literatur

AppAnnie (2017). Spotlight–App-Nutzung durch Verbraucher.

Bertelsmann Stiftung (2016). Health Apps, Spotlight Healthcare. Gütersloh.

CISCO (2020). Cisco Annual Internet Report (2018–2023), White paper.

Giacomo, D.; De Liso, G.; Ranieri, J. (2018). Self body-management and thinness in youth: survey study on Italian girls in: Health and Quality of Life Outcomes. https://doi.org/10.1186/s12955-018-0937-4

Dark Patterns. https://darkpatterns.org

European Parliament, European Commission (EP, EC Regulation 2016/679). Regulation (EU) 2016/679 of the European Parliament and of the Council of 27 April 2016 on the protection of natural persons with regard to the processing of personal data and on the free movement of such data, and repealing Directive 95/46/EC (General Data Protection Regulation. https://data.europa.eu/eli/reg/2016/679/o

European Commission (EU COM 2020/65 final). Directorate-General for Communications Networks, Content and Technology: White Paper – Artificial Intelligence -A European approach to excellence and trust. https://op.europa.eu/s/oaNu

European Economic and Social Committee (EESC 2019). The digital revolution in view of citizens‘ needs and rights OPINION TEN/679, Rapporteur: Ulrich Samm, Brüssel, 20.02.2020.

IFR International Federation of Robotics (2019). Executive Summary World Robotics 2019 Industrial Robots – Editorial

IFR International Federation of Robotics (2020). Top Trends Robotics 2020.

Meidert, U.; Scheermesser, M.; Prieur, Y.; Hegyi, S.; Stockinger, K.; Eyyi, G.; Evers-Wölk, M.; Jacobs, M.; Oertel, B.; Becker, H. (2018). Quantified Self – Schnittstelle zwischen Lifestyle und Medizin. TA-SWISS 67, Zurich. https://doi.org/10.3218/3892-7

Meyer, B; Asrock, F (2018). Disabled or cyborg? How bionics affect stereotypes toward people with physical disabilities. Frontiers in Psychology, 9(2251), 1-13. https://doi.org/10.3389/fpsyg.2018.02251

Moll, R.; Schulze, A.; Rusch-Rodosthenous, R.; Kunke, C,; Scheibel, L. (2017). Wearables, Fitness-Apps und der Datenschutz: Alles unter Kontrolle? Verbraucherzentrale NRW e. V.

Reinberger, S (2017). Digitale Medien. Neue Medien – Fluch oder Segen? In: Gemeinnützige Hertie Stiftung: G_AP Gehirn – Anwendung Praxis (project report). Fokus Schule. Royal Society for Public Health: #StatusOfMind – Social media and young people‘s mental health and wellbeing, London May 2017

Zimmermann, N. (2020). The Digital Self. DIGIT-AL – Digital Transformation Adult Learning for Active Citizenship. DARE Blue Lines, Democracy and Human Rights Education in Europe, Brussels 2020.

Zuboff, S (2015). Big Other: Surveillance Capitalism and the Prospects of an Information Civilization (April 4, 2015). Journal of Information Technology (2015) 30, 75–89. https://doi.org/10.1057/jit.2015.5